او با درک نیاز من به کاهش همه چیز به تلویزیون از دهه 80، پیشنهاد می کند که در عوض تمرین کنیم که با هوش مصنوعی خود مانند Picard صحبت کنیم. پیشتازان فضا، با “دستورالعمل های واضح و روشن.” فهمیدم. “آئودی، چای، ارل گری، داغ.” و فقط در صورتی که لمواین درست می گوید: “لطفا.”

آیا وسایل نقلیه مجهز به هوش مصنوعی نیز احساساتی دارند؟

مویس ناوون، مدرس اخلاق فناوری در دانشگاه بن گوریون نقب در بیرشبا، اسرائیل، میگوید: «شما آن را تا آخر پیش میبرید». ناوون خاطرنشان می کند که تلاش ها برای ایجاد هوشیاری در هوش مصنوعی چندین دهه عمیق است، و علیرغم افکار Lemoine و پروازهای تخیلی من، ما به کامپیوترهایی با احساسات واقعی نزدیک نیستیم. او می گوید: «ماشین اگر نتواند درد و لذت را احساس کند، رحمت ما را طلب نمی کند. بنابراین، از نظر اخلاقی، لازم نیست نگران احساسات ماشین باشیم، اما ناوون میگوید رفتار ما نسبت به اشیاء انساننما میتواند بعداً در رفتار ما نسبت به موجودات زنده منعکس شود. او می گوید: «یکی از دوستان من به تازگی یک الکسا خریده است. “او از من پرسید که آیا باید به آن “لطفا” بگوید یا خیر. “

از شماره سپتامبر 2022 از ماشین و راننده.

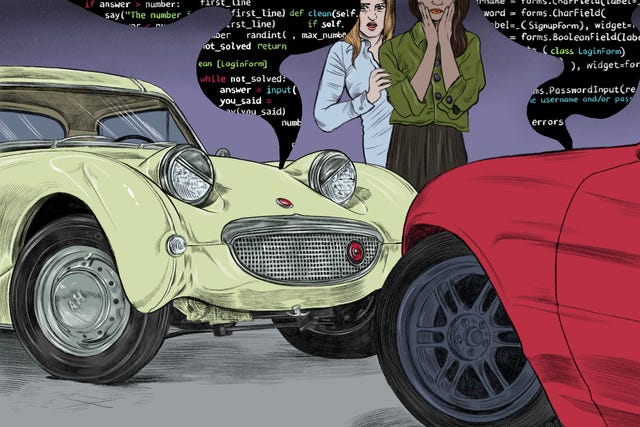

در حال حاضر، ماشینهای ما اهمیتی نمیدهند که شما با آنها رفتار خوبی داشته باشید. حتی اگر کثیف گذاشتن آنها به نظر اشتباه باشد، به آنها اجازه دهید زنگ درب را دریافت کنند یا آنها را با اکتان 87 اجرا کنند، هیچ آسیب روحی وارد نمی شود. ممکن است به یک مکانیک پول بیشتری بپردازید، اما به یک درمانگر نه. هشدارهای هوندا سنسینگ و محصولات هیوندای/کیا در مورد شروع حرکت خودروی جلویی و دستورات سیستم ناوبری در مرسدس که سه پیچ پشت سر هم را از دست میدهید، نشانهای از این نیست که خودرو در حال خفگی است. هر احساسی مبنی بر افزایش فوریت هشدارهای چشمک زن یا تغییر لحن، تخیل ناب راننده است. نسبت دادن احساسات به خودروهایمان، با تناسبات چهارپا، همراهی ثابت و چهرههای مشتاق، آسان است. اما آنها احساساتی ندارند – حتی آنهایی مانند آستین-هیلی اسپرایتز.

نحوه موتور با آداب

در اوایل ماه ژوئن، بلیک لمواین، مهندس گوگل که بر روی هوش مصنوعی کار میکند، با ادعای اینکه مدل زبانی این شرکت برای برنامههای گفتگو (LaMDA) خودآگاه است، خبرساز شد. Lemoine متن مکالمه خود را با LaMDA به اشتراک گذاشت که به گفته او ثابت کنید که روح دارد و باید به عنوان یک همکار رفتار کرد تا یک ابزار. مهندسان دیگر مانند من متقاعد نشدند. من رونوشت ها را خواندم. هوش مصنوعی در یک مهمانی دانشگاهی مانند یک سنگربان آزاردهنده صحبت می کند، و من مطمئن هستم که این افراد فاقد هرگونه خودآگاهی هستند. با این حال، تفسیر لموئین قابل درک است. اگر چیزی از امیدها و رویاهایش صحبت می کند، پس گفتن اینکه هیچ ندارد، بی احساس به نظر می رسد.

تصویر توسط دیلک بایکراماشین و راننده

وقتی آنها انجام دهند چه اتفاقی می افتد؟ آیا خودرویی که سوختش کم است، اعلام می کند که برای رفتن خیلی گرسنه است، حتی زمانی که شما دیر سر کلاس هستید و به اندازه کافی برای رفتن به آنجا با دود وجود دارد؟ اگر ماشین شما عاشق BMW همسایه شود یا بدتر از آن، با فورد همسایه دشمنی کند چه اتفاقی می افتد؟ آیا می توانید در نهایت با یک ماشین ترسناک روبرو شوید، خودرویی که پس از تاریک شدن هوا به مناطق بد یا در بیابان نمی رود؟ اگر چنین است، آیا می توانید آن را مجبور به رفتن کنید؟ آیا می توان با ماشین ظلم کرد؟